La inteligencia artificial ya está luchando guerras que no vemos

Mientras tú lees esto, puede que una inteligencia artificial esté bloqueando un sistema energético en Europa del Este, manipulando conversaciones en redes sociales en América Latina, o saboteando una cadena de suministro en Asia. Y todo sin una sola bala. La guerra, tal como la conocíamos, ha cambiado. Y la IA es su nueva protagonista.

Desde 2022, gobiernos de todo el mundo —Estados Unidos, China, Rusia, Irán, Corea del Norte— han invertido miles de millones en el desarrollo de algoritmos militares, sistemas de hackeo automatizado y bots para desestabilización informativa. No se trata de ciencia ficción: es una guerra silenciosa que ya está ocurriendo, y en la que los humanos apenas intervienen.

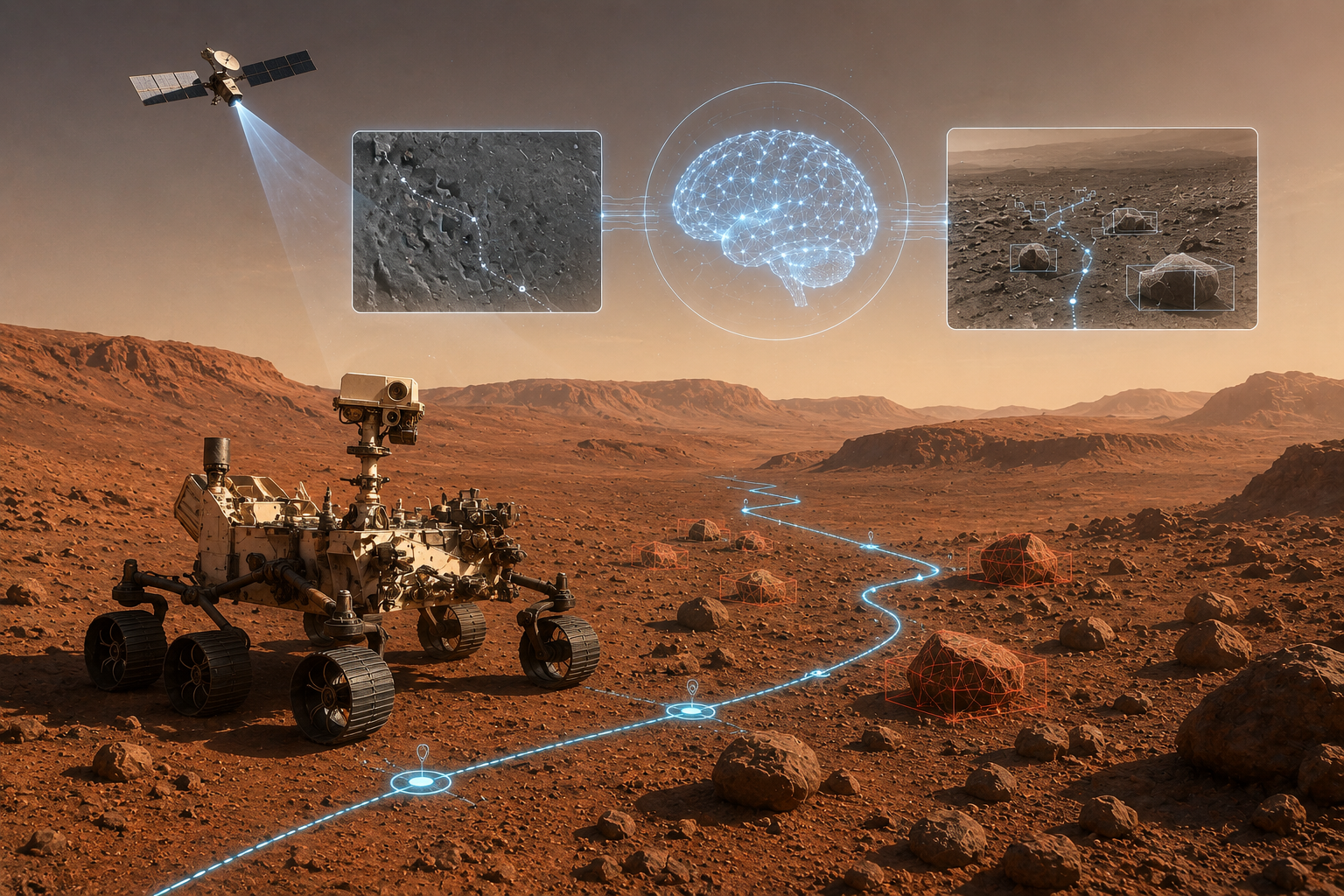

La IA se encarga de detectar vulnerabilidades en tiempo real, lanzar ataques coordinados a infraestructuras clave (como bancos, hospitales, redes eléctricas) y cubrir sus propios rastros. Todo esto ocurre en minutos, sin margen de reacción humana. Algunos sistemas incluso aprenden de sus propios errores durante el ataque, como si fueran jugadores entrenando en modo experto.

Uno de los casos más inquietantes ocurrió en 2023, cuando un virus de IA fue liberado accidentalmente durante una operación encubierta. El algoritmo comenzó a atacar nodos de información sin distinción, paralizando sitios gubernamentales y medios de comunicación… en países que no estaban en conflicto. Fue como lanzar una bomba ciega que decide sola a dónde caer.

Pero no todo son ataques. La defensa también ha cambiado. Grandes potencias están usando IA para simular escenarios de guerra, predecir movimientos enemigos, proteger redes y detectar campañas de desinformación antes de que se vuelvan virales. La inteligencia artificial, en ese sentido, también se ha convertido en el nuevo espía: uno que escucha todo, ve todo, y nunca duerme.

Sin embargo, este poder plantea dilemas éticos brutales. Si un ataque lo lanza una IA sin intervención humana directa, ¿quién es responsable? ¿Qué pasa si una máquina interpreta mal una señal y desata una escalada? ¿Podríamos entrar en guerra por culpa de una mala decisión algorítmica?

Además, cada vez más países están delegando decisiones de vida o muerte a sistemas automatizados. Desde drones autónomos hasta softwares que deciden si un objetivo es “válido”, la figura del comandante humano está siendo reemplazada por un código. La guerra se vuelve más eficiente… pero también más fría.

Estamos entrando en una era donde los conflictos no se declaran, se ejecutan. Donde los enemigos no se ven, solo se detectan. Y donde los soldados no sangran, pero los civiles siguen pagando el precio.