Mixture of Experts (MoE): optimización en el entrenamiento de modelos de lenguaje con IA

En la era de la inteligencia artificial, los modelos de lenguaje a gran escala, como GPT-3, han demostrado capacidades asombrosas para generar texto, traducir idiomas y responder preguntas con precisión. Sin embargo, el entrenamiento de estos modelos requiere una enorme cantidad de recursos computacionales, lo que limita su desarrollo y accesibilidad. La arquitectura Mixture of Experts (MoE) emerge como una solución innovadora para superar estas limitaciones, permitiendo entrenar modelos más grandes y eficientes que nunca.

¿Qué es Mixture of Experts (MoE)?

Imagine un equipo de especialistas, cada uno con un área de conocimiento específica. En lugar de que una sola persona intente resolver todos los problemas, cada experto se encarga de las tareas que domina. Esta es la idea central detrás de MoE.

En lugar de utilizar capas densas tradicionales, donde todas las neuronas procesan todas las entradas, MoE divide el modelo en múltiples «expertos», que son redes neuronales más pequeñas especializadas en diferentes aspectos del lenguaje. Una red de enrutamiento, como un controlador de tráfico inteligente, asigna cada parte de la entrada (tokens) al experto más adecuado para procesarla.

Beneficios de MoE:

- Eficiencia Computacional: Al activar solo un subconjunto de expertos para cada entrada, MoE reduce significativamente la cantidad de cálculos necesarios durante el entrenamiento. Esto permite entrenar modelos más grandes con el mismo presupuesto computacional o entrenar modelos existentes de forma más rápida.

- Especialización y Rendimiento: Cada experto se especializa en un tipo específico de información o tarea, lo que mejora la capacidad del modelo para comprender y generar lenguaje. Esto se traduce en una mayor precisión en tareas como la traducción automática, la generación de texto y la respuesta a preguntas.

- Escalabilidad: MoE facilita el entrenamiento de modelos con billones de parámetros, abriendo nuevas posibilidades para la investigación en IA y el desarrollo de aplicaciones más sofisticadas.

Aplicaciones de MoE:

- Modelos de Lenguaje a Gran Escala: MoE es crucial para el desarrollo de la próxima generación de modelos de lenguaje, que podrán comprender y generar texto con una fluidez y precisión sin precedentes.

- Traducción Automática: La especialización de los expertos en diferentes idiomas y dominios mejora la calidad de la traducción, especialmente en textos técnicos o con jerga específica.

- Generación de Contenido: MoE permite crear sistemas de IA capaces de generar contenido creativo y original, como artículos de noticias, poemas o guiones.

- Asistentes Virtuales: Los asistentes virtuales con MoE pueden comprender mejor las solicitudes de los usuarios y proporcionar respuestas más relevantes y precisas.

El Futuro de MoE:

La arquitectura MoE está impulsando una nueva ola de innovación en el campo de la IA. A medida que la investigación avanza, podemos esperar:

- Modelos aún más grandes y eficientes: MoE permitirá el desarrollo de modelos con capacidades cognitivas cada vez más sofisticadas.

- Mayor especialización de los expertos: Los expertos se especializarán en áreas de conocimiento cada vez más específicas, mejorando la precisión y el rendimiento del modelo.

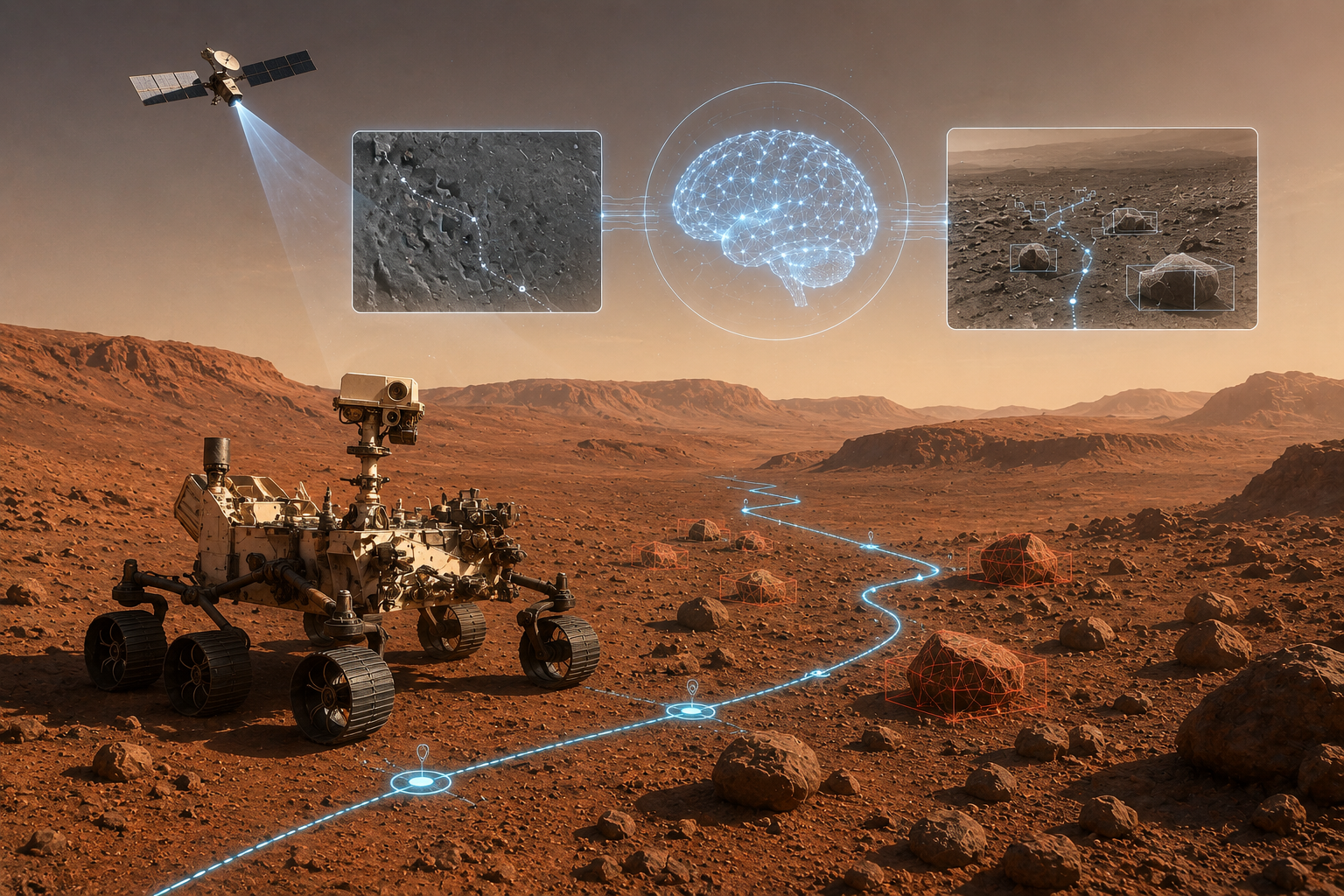

- Nuevas aplicaciones: MoE se aplicará a una gama más amplia de tareas, como el análisis de imágenes, el procesamiento del habla y la robótica.

Conclusión:

Mixture of Experts es una arquitectura revolucionaria que está transformando el panorama de la IA. Al permitir el entrenamiento de modelos de lenguaje más grandes, eficientes y especializados, MoE está abriendo un nuevo camino hacia la creación de sistemas de IA más inteligentes y capaces. Esta tecnología promete impulsar avances significativos en una variedad de campos, desde la comunicación y la educación hasta la atención médica y la investigación científica.