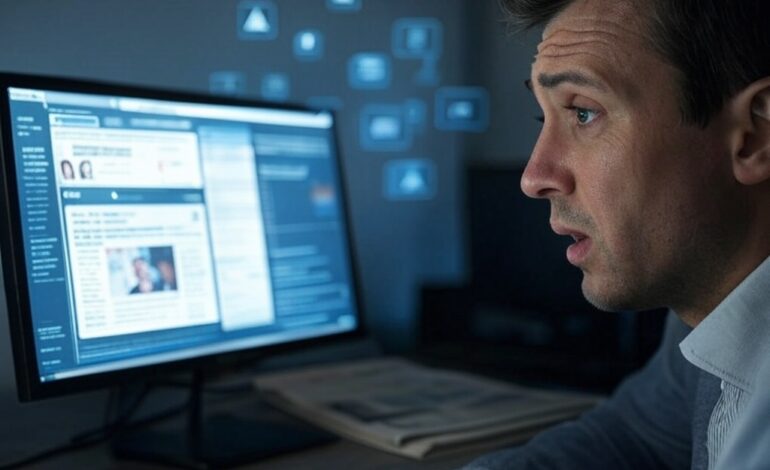

BBC alerta sobre errores en resúmenes de noticias generados por IA

La IA no siempre dice la verdad: BBC detecta errores graves en resúmenes de noticias generados por IA

La inteligencia artificial (IA) ha revolucionado la forma en que consumimos información. Sin embargo, una reciente investigación de la BBC ha puesto en evidencia un problema alarmante: los chatbots de IA están distorsionando noticias en sus resúmenes automáticos. Herramientas como ChatGPT, Google Gemini y Microsoft Copilot están generando contenido inexacto, lo que podría impactar la confianza en la información digital.Según el estudio, de 100 artículos analizados, más del 50% de los resúmenes generados por IA contenían errores significativos, incluyendo declaraciones incorrectas, citas imprecisas y omisiones clave. La BBC ha instado a las empresas tecnológicas a mejorar sus sistemas y colaborar con la industria periodística para garantizar una información precisa

Los errores más comunes en los resúmenes de IA

El análisis de la BBC reveló tres tipos principales de errores en los resúmenes generados por IA:

- Citas alteradas: En varias ocasiones, los chatbots modificaron declaraciones de figuras públicas, cambiando el sentido original de sus palabras.

- Hechos tergiversados: Algunas noticias fueron resumidas con información incorrecta, generando confusión y posibles malentendidos.

- Falta de contexto: Muchas veces, los resúmenes omitieron detalles esenciales, lo que llevó a una interpretación errónea de la noticia.

Impacto en la confianza del público

Estos errores pueden tener consecuencias graves en la confianza del público. En una era donde la desinformación prolifera, el uso de IA para generar contenido noticioso debe ser transparente y riguroso.

Un estudio reciente de Pew Research Center reveló que más del 60% de los usuarios digitales ya desconfían de la precisión de la información generada por IA. Esto refuerza la necesidad de que las empresas tecnológicas refinen sus algoritmos para evitar errores críticos.

La respuesta de las empresas tecnológicas

Tras la publicación del informe de la BBC, algunas compañías han respondido:

- OpenAI afirmó que está mejorando su modelo ChatGPT para reducir errores en información factual.

- Google aseguró que Google Gemini está incorporando métodos de verificación de datos más rigurosos.

- Microsoft prometió optimizar Copilot para ofrecer resúmenes más precisos y confiables.

¿Cómo evitar caer en la desinformación de la IA?

Si bien las herramientas de IA son una gran ayuda para el acceso rápido a la información, es fundamental que los usuarios adopten prácticas responsables al consumir noticias generadas por estas tecnologías:

Verificar las fuentes originales antes de compartir información.

Comparar noticias en múltiples medios confiables.

Utilizar herramientas de fact-checking para detectar noticias falsas.

El estudio de la BBC expone una problemática creciente: los chatbots de IA aún no son completamente confiables para resumir noticias. Aunque la tecnología está evolucionando, la supervisión humana sigue siendo clave para garantizar información precisa y evitar la propagación de desinformación involuntaria.

La IA tiene un potencial enorme en el periodismo digital, pero también requiere una implementación responsable para que su impacto sea positivo.